1 Cours de Probabilités et Statistiques. I - Modèles discrets Table 1 1.0. Bibl

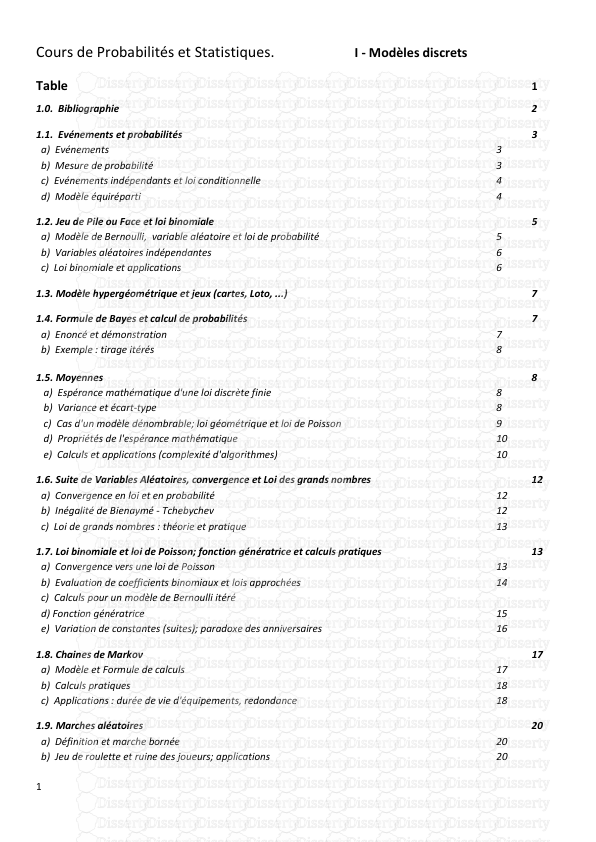

1 Cours de Probabilités et Statistiques. I - Modèles discrets Table 1 1.0. Bibliographie 2 1.1. Evénements et probabilités 3 a) Evénements 3 b) Mesure de probabilité 3 c) Evénements indépendants et loi conditionnelle 4 d) Modèle équiréparti 4 1.2. Jeu de Pile ou Face et loi binomiale 5 a) Modèle de Bernoulli, variable aléatoire et loi de probabilité 5 b) Variables aléatoires indépendantes 6 c) Loi binomiale et applications 6 1.3. Modèle hypergéométrique et jeux (cartes, Loto, ...) 7 1.4. Formule de Bayes et calcul de probabilités 7 a) Enoncé et démonstration 7 b) Exemple : tirage itérés 8 1.5. Moyennes 8 a) Espérance mathématique d'une loi discrète finie 8 b) Variance et écart-type 8 c) Cas d'un modèle dénombrable; loi géométrique et loi de Poisson 9 d) Propriétés de l'espérance mathématique 10 e) Calculs et applications (complexité d'algorithmes) 10 1.6. Suite de Variables Aléatoires, convergence et Loi des grands nombres 12 a) Convergence en loi et en probabilité 12 b) Inégalité de Bienaymé - Tchebychev 12 c) Loi de grands nombres : théorie et pratique 13 1.7. Loi binomiale et loi de Poisson; fonction génératrice et calculs pratiques 13 a) Convergence vers une loi de Poisson 13 b) Evaluation de coefficients binomiaux et lois approchées 14 c) Calculs pour un modèle de Bernoulli itéré d) Fonction génératrice 15 e) Variation de constantes (suites); paradoxe des anniversaires 16 1.8. Chaines de Markov 17 a) Modèle et Formule de calculs 17 b) Calculs pratiques 18 c) Applications : durée de vie d'équipements, redondance 18 1.9. Marches aléatoires 20 a) Définition et marche bornée 20 b) Jeu de roulette et ruine des joueurs; applications 20 2 Bibliographie [1] J. Bass : 'Eléments de Calcul des Probabilités' Masson, 1974 [2] K. L. Chung, F. Aitshalia : ‘ Elementary probability Theory’ Springer, 2003 [3] P. Deheuvels : ‘La probabilité, le hasard et la certitude’ Que sais-je, PUF, 1982. [4] W. Feller : ' An Introduction to Probability Theory and its Applications ' Tome 1, Wiley, 1966 [5] D. Foata, A. Fuchs : 'Calcul des Probabilités' Dunod, 1998 [6] B. V. Gnedenko : 'The Theory of probability' CRC Press, 1998 [7] C. Graham : 'Chaînes de Markov' Dunod, 2008 [8] A. Jacquard : ‘Les probabilités’ Que sais-je, PUF, 1974. [9] Johnson, Kemp, Kotz : ‘Univariate Discrete Distributions’ Wiley, 2005. [10] P. Meunier : 'Probabilités discrètes' Cepad, 2015 [11] H. Ventzell : ‘Théorie des probabilités’ Editions Mir, 1973, 1987 3 I - Modèles discrets 1.1. Evénements et probabilités a) Evénements Les événements peuvent être représentés par des assertions, en langage courant ou de manière plus formelle, représentant des cas finis simples (une pièce tombe sur Pile), ou des situations moins immédiates (un thermomètre indique une température de 20° C, ou la météo a prévu 3 jours de pluie). Ils sont modélisés dans le modèle de Kolmogorov comme des ensembles, parties d'un univers , ensemble de tous les possibles. Cet univers peut être explicité pour représenter des situations assez simples comme des jeux de hasard, ou être implicite dans la plupart des cas. Les deux langages sont utilisés pour exprimer des événements courants, avec une correspondance entre conjonction et disjonction d'une part, intersection et réunion de l'autre. L'ensemble des événements peut être l'ensemble P () des parties de , ou un sous ensemble A. Cet ensemble A sera stable pour la réunion, l'intersection (finie ou dénombrable) et pour la complémentation, et contiendra toujours (et donc aussi l'ensemble vide). On dira que A est une tribu de . On dira donc aussi la tribu des événements. b) Mesure de probabilité Les évènements sont les objets dont on peut exprimer la probabilité : P est une application de A dans R I ou dans [0, 1] qui est dite mesurable : si A et B sont des événements incompatibles, ou si ce sont des ensembles disjoints, P (A B) = P (A) + P (B), et plus généralement si (An)n 0 est une suite d'événements deux à deux disjoints, P ( An ) = P (An) n 0 n 0 Cette propriété est dite de mesurabilité (dénombrable), et l'application P est dite mesure de probabilité. C'est la même propriété que pour la mesure des longueurs ou des aires du plan, et on peut prendre cette dernière comme représentation géométrique de la mesure de probabilité des événements. La principale différence avec la mesure des longueurs est que la mesure de probabilité est finie, et plus précisément P () = 1, et pour tout événement A, P (A) 1 On déduit de la mesurabilité de P que : i) P (Ac) = 1 – P (A) ii) P (A B) = P (A) + P (B) – P (A B) iii) Si A B, P (B – A) = P (B) – P (A) 0, et P (A) P (B) iv) P (A B C) = P (A) + P (B) + P (C) – P (A B) – P (A C) – P (B C) + P (A B C) (Formule du crible, généralisable à un nombre fini quelconque) v) Si A est un ensemble fini : A ={1, 2, ..., m}, P (A) = P ({1}) + P ({2}) + ... + P ({m}) En particulier quand on cherche à calculer en pratique P (A) on cherchera l'expression la plus simple de P (A) et P (Ac) Et si on connait P (A), P (B) et P (A B), il suffira d'écrire P (A B) = P (A) + P (B) – P (A B). Par exemple, si on lance un dé à 6 faces, on peut choisir comme univers = {1, 2, 3, 4, 5, 6}. Cet univers suffit à décrire le jeu ou l'expérience consistant en un seul lancer de dé. On peut évaluer les probabilités suivantes : P (face différente de 6) = P ({1, 2, 3, 4, 5}) = 1 – P (6) = 5/6, en écrivant P () = P ({}) P (face paire) = P ({2, 4, 6}) = P (2) + P (4) + P (6) = 1/6 + 1/6 + 1/6 = 3/6 = 1/2 P (face paire ou le numéro de face est un nombre premier) = P (A B) = P (A) + P (B) – P (A B) = 1/2 + 1/2 – 1/6 4 Les événements de probabilité nulle seront négligés, et correspondent de fait à des situations qui ne peuvent arriver : Si P (A) = 0, A ne peut être observé en pratique. Si A correspond au résultat d'une expérience qu'on peut itérer, on pourra également répéter cette expérience autant de fois qu'on le souhaite sans jamais observer ce résultat. Pour les questions pratiques, il en sera de même d'événements de très faible probabilité. même si la probabilité de cet événement peut paraitre très faible, si les joueurs de Loto achètent des billets c'est bien dans l'espoir de gagner un jour le gros lot. Qu'en serait-il si cette probabilité était de 10–50, quel que soit le montant des lots ? Il est à parier que peu de personnes jouent. c) Evénements indépendants et loi conditionnelle Deux événements A et B sont indépendants si l'occurrence de l'un n'influe pas sur la probabilité de l'autre, ou encore si P (A/B) = P (A), ou de manière équivalente si P (B/A) = P (B). Si on note PB la mesure (*) de probabilité sachant B : pour tout événement A, PB (A) = P (A/B). L'univers, ensemble de tous les possibles, est alors réduit à l'ensemble B, et tout événement A ne peut être considéré que conjointement à B, soit si P (B) 0, P (A/B) = P (A B)/ P (B). Par suite, quels que soient les événements A et B, Définition 1.1 A et B sont indépendants si P (A B) = P (A) . P (B). Ainsi si on lance deux fois un dé à six faces, avec des lancers indépendants, la probabilité d'avoir deux fois un 6 est de 1/6 . 1/6 = 1/36 * Propriété 1.1 PB est une mesure. Démonstration : PB () = P (B) / P (B) = 1. Si A C = , : PB (A C) = P [(A C) B] / P (B) = P [(A B) (C B)] / P (B) et comme (A B) (C B) = A C B = , PB (A C) = P (A B) / P (B) + P (C B) / P (B) = P (A/B) + P (C/B) = PB (A) + PB (C) Cette propriété d'additivité se généralise immédiatement au cas dénombrable. Remarque : Si A et B sont indépendants, P (A B) = P (A) + P (B) – P (A) . P (B) d) Modèle équiréparti Si uploads/Histoire/ cours-probastat1.pdf

Documents similaires

-

195

-

0

-

0

Licence et utilisation

Gratuit pour un usage personnel Attribution requise- Détails

- Publié le Dec 21, 2022

- Catégorie History / Histoire

- Langue French

- Taille du fichier 1.4160MB